LLM Agents: kiến trúc, framework và ứng dụng thực tế

LLM agents chuyển các model ngôn ngữ từ chatbot thụ động thành hệ thống tự chủ có khả năng lập kế hoạch, ghi nhớ và hành động độc lập. Bài viết giải thích kiến trúc 4 thành phần cốt lõi (LLM brain, planning logic, memory, tools), 5 loại agents từ cơ bản đến phức tạp, 3 framework phổ biến (LangChain, LlamaIndex, CrewAI), và ứng dụng thực tế trong coding, phân tích kinh doanh và tổng hợp tài liệu.

Tóm tắt các điểm chính

- LLM agents khác chatbot truyền thống ở chỗ sử dụng LLM như "bộ não" kết hợp với planning logic, memory và tools để hành động tự chủ thay vì chỉ phản hồi câu hỏi

- Bốn thành phần cốt lõi: LLM brain (quyết định hành động tiếp theo), planning logic (chia nhỏ vấn đề phức tạp), memory (short-term trong context và long-term qua vector databases), và tools (tương tác với thế giới thực)

- Năm loại agents theo độ phức tạp tăng dần: Simple Reflex (condition-action rules), Model-Based Reflex (theo dõi trạng thái), Goal-Based (lập kế hoạch đạt mục tiêu), Utility-Based (tối ưu hóa kết quả), Learning (cải thiện qua phản hồi)

- Ba framework chính: LangChain cho tính linh hoạt và kiểm soát, LlamaIndex cho xử lý tài liệu phức tạp, CrewAI cho cộng tác multi-agent với phân vai rõ ràng

- Thách thức lớn: hallucinations và sai sót lập kế hoạch, độ trễ cao và chi phí tăng do nhiều lần gọi LLM, debugging phức tạp hơn code truyền thống

LLM agent là gì?

Hãy nói về cách LLM agents khác với các model ngôn ngữ tiêu chuẩn.

Giao diện LLM thông thường của bạn, như chatbot, chỉ có thể nhận lệnh và trả về phản hồi được tạo dựa trên huấn luyện của nó, không có hành động hoặc trạng thái bên ngoài. Ngược lại, một LLM agent sử dụng LLM như công cụ suy luận cốt lõi (như bộ não) và bao quanh nó bằng các thành phần hỗ trợ cho phép nó suy luận, lập kế hoạch và thực thi.

LLM agents chuyển trọng tâm từ tự động hóa sang tự chủ.

Tự động hóa cho phép LLM nhận đầu vào và làm theo một loạt bước để tạo đầu ra. Với tính tự chủ, chúng ta đưa cho LLM một bộ công cụ và khả năng tự quyết định cách tốt nhất để đến với giải pháp dựa trên những gì nó biết về tình huống. Điều này mang lại nhiều linh hoạt và độ phức tạp hơn để LLM hành động "độc lập".

Hãy nghĩ về một LLM đơn thuần như một chuyên gia tư vấn trả lời câu hỏi dựa trên kiến thức của họ. Một LLM agent giống như chuyên gia đó lãnh đạo một team: nó quyết định câu hỏi nào cần hỏi, thành viên team nào (công cụ nào) cần tham khảo, và cách kết hợp câu trả lời của họ thành giải pháp.

Các thành phần cốt lõi của LLM agent

Một LLM agent bao gồm một số thành phần cốt lõi:

- LLM (bộ não)

- Planning logic (logic lập kế hoạch)

- Memory (bộ nhớ)

- Tools (công cụ)

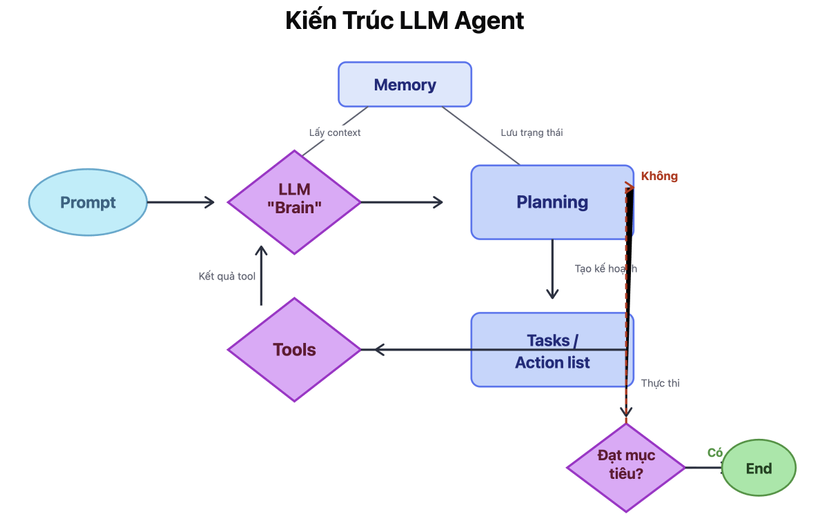

Biểu đồ sau minh họa mối quan hệ giữa từng thành phần.

LLM brain (bộ não)

LLM đóng vai trò là lõi nhận thức của agent. Nó diễn giải mục tiêu của người dùng, suy luận về các bước trung gian và quyết định hành động nào cần thực hiện. Trên thực tế, LLM được gọi lặp lại nhiều lần, không chỉ một lần.

Mỗi lần LLM được gọi, nó nhận ngữ cảnh có thể bao gồm mục tiêu ban đầu, các hành động trước đó, đầu ra công cụ và bộ nhớ liên quan. Dựa trên thông tin này, nó quyết định hành động tiếp theo. Điều này làm cho LLM hoạt động giống như bộ điều khiển hơn là trình tạo văn bản tĩnh.

Điều quan trọng cần hiểu là LLM không trực tiếp thực thi code hoặc truy vấn. Nó tạo ra các hướng dẫn có cấu trúc mà các thành phần khác diễn giải. Chất lượng của một agent thường phụ thuộc vào mức độ tốt của các hướng dẫn này được ràng buộc và xác thực.

Planning logic (logic lập kế hoạch)

Planning logic là cơ chế cho phép agents giải quyết các vấn đề phức tạp bằng cách chia nhỏ chúng thành các bước có thể quản lý. Không có lập kế hoạch, một agent sẽ cố gắng giải quyết mọi thứ trong một phản hồi duy nhất, thường dẫn đến lỗi hoặc hallucinations.

Trong giai đoạn lập kế hoạch, agent phân tách một mục tiêu cấp cao thành các công việc nhỏ hơn. Ví dụ, "Phân tích tỷ lệ khách hàng rời bỏ" có thể trở thành "tải dữ liệu khách hàng", "tính tỷ lệ rời bỏ", "xác định xu hướng" và "tóm tắt phát hiện". Mỗi công việc con sau đó được thực hiện tuần tự hoặc có điều kiện.

Một kỹ thuật phổ biến là Chain-of-Thought (CoT), khuyến khích model suy luận một cách rõ ràng bằng cách xâu chuỗi một loạt hành động như các lệnh tuần tự.

ReAct (reasoning and acting - suy luận và hành động) đi xa hơn một bước và xen kẽ các dấu vết suy luận với các hành động gọi công cụ và quan sát bên ngoài. Phản hồi bên ngoài này giúp agents duy trì căn cứ và tự sửa chữa khi kết quả trung gian không khớp với kỳ vọng.

Memory (bộ nhớ)

Memory cho phép một agent duy trì tính liên tục qua các tương tác và hành động bằng cách tái sử dụng thông tin trước đó. Không có bộ nhớ, mỗi bước sẽ bị cô lập, buộc agent phải khám phá lại cùng kiến thức nhiều lần.

Short-term memory (bộ nhớ ngắn hạn) thường tồn tại trong context window của LLM. Nó bao gồm tin nhắn gần đây, suy luận trung gian và đầu ra công cụ. Giống như RAM trong kiến trúc máy tính, bộ nhớ này nhanh nhưng hạn chế và biến mất khi context bị vượt quá.

Long-term memory (bộ nhớ dài hạn) được triển khai bên ngoài, thường sử dụng vector databases. Các kỹ thuật như RAG (Retrieval-Augmented Generation) cho phép agent truy xuất tài liệu liên quan hoặc tương tác trước đó và đưa chúng vào ngữ cảnh hiện tại.

Tools (công cụ)

Tools mở rộng khả năng của agent vượt ra ngoài ngôn ngữ. Chúng cho phép agent tương tác với thế giới thực, bao gồm cơ sở dữ liệu, API và công cụ tính toán.

Từ góc độ của agent, tools là các hàm có thể gọi với đầu vào và đầu ra được định nghĩa. LLM quyết định khi nào sử dụng công cụ, cung cấp đối số gì và cách diễn giải kết quả. Khả năng ra quyết định này là điều phân biệt agents khỏi các quy trình làm việc được viết kịch bản sẵn.

Tools có thể bao gồm các tính năng như tìm kiếm Google, thực thi SQL, trình thông dịch Python và API. Agent thực sự có quyền truy cập vào các công cụ công nghệ giống như chúng ta và có thể kết hợp chúng lại để thực hiện giải pháp.

Hình ảnh trên mô tả kiến trúc LLM agent tổng quát. Bộ não cung cấp thông tin bộ nhớ và lập kế hoạch, sau đó bắt đầu một loạt công việc sử dụng công cụ.

Các loại LLM agents

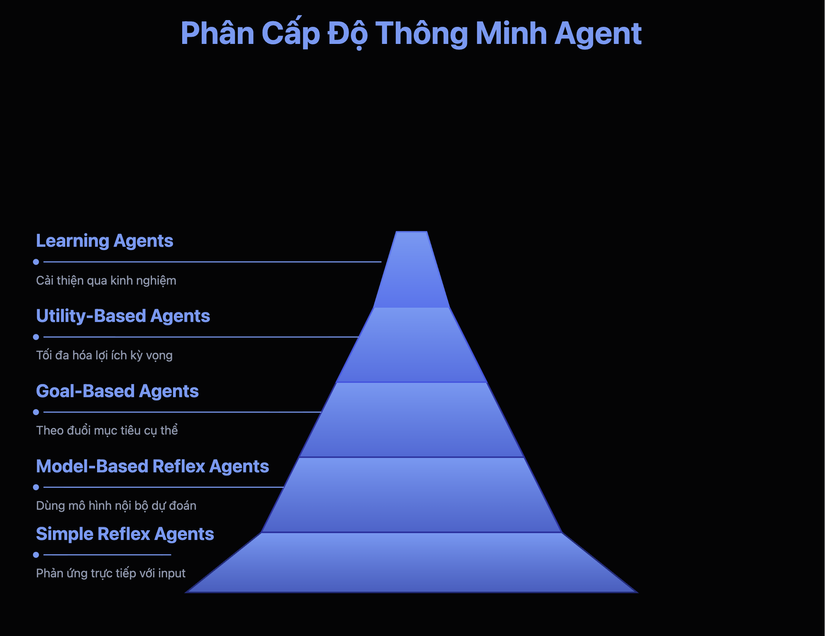

Phần này tóm tắt các loại agents khác nhau từ reflex agents cơ bản nhất đến learning agents phức tạp.

Simple Reflex Agents (Agents phản xạ đơn giản)

Simple reflex agents hoạt động dựa trên các quy tắc điều kiện-hành động trực tiếp. Chúng không xem xét lịch sử, hậu quả tương lai hoặc hành động thay thế. Nếu một điều kiện được đáp ứng, hành động tương ứng được thực hiện ngay lập tức.

Sự đơn giản này làm cho chúng dễ triển khai, nhưng chúng cực kỳ mong manh. Bất kỳ đầu vào ngoài dự kiến hoặc tín hiệu bị thiếu đều có thể gây ra hành vi không chính xác. Chúng cũng không thể thích nghi với môi trường thay đổi.

Ví dụ về bot hủy đăng ký email làm nổi bật giới hạn này. Nó thực hiện công việc của mình nhanh chóng nhưng thiếu nhận thức, có thể dẫn đến kết quả không mong muốn.

Model-Based Reflex Agents (Agents phản xạ dựa trên model)

Model-based reflex agents cải thiện simple reflex agents bằng cách duy trì biểu diễn nội bộ về môi trường. Model nội bộ này cho phép chúng suy luận về những thứ không thể thấy ngay lập tức.

Bằng cách theo dõi trạng thái theo thời gian, các agents này có thể xử lý khả năng quan sát một phần. Chúng nhớ những gì đã xảy ra và sử dụng thông tin đó để thông báo cho các hành động trong tương lai.

Các trợ lý IDE như Copilot hoặc Cursor AI là ví dụ mạnh mẽ. Chúng duy trì nhận thức về các file, biến và hàm qua một phiên làm việc, cho phép các đề xuất thông minh hơn so với khớp mẫu đơn giản. Chúng cũng là cầu nối đến loại agents tiếp theo.

Goal-Based Agents (Agents dựa trên mục tiêu)

Goal-based agents được thiết kế xung quanh kết quả thay vì triggers. Chúng lập kế hoạch và đánh giá hành động dựa trên việc liệu chúng có di chuyển hệ thống gần hơn đến mục tiêu mong muốn hay không thay vì chỉ phản ứng thuần túy.

Các agents này tạo ra các kế hoạch có thể liên quan đến nhiều bước và phân nhánh có điều kiện. Nếu một cách tiếp cận thất bại, chúng có thể thử một con đường thay thế. Điều này làm cho chúng linh hoạt hơn đáng kể so với các agents dựa trên phản xạ.

Ví dụ, tạo lịch trình du lịch minh họa cách một mục tiêu cấp cao duy nhất có thể được phân tách thành nhiều hành động phối hợp qua các hệ thống.

Agent không chỉ phản hồi lệnh đơn giản "cho tôi một lịch trình" và trả lại thông tin. Thay vào đó, nó có thể chia nhỏ mục tiêu thành các bài toán con nhỏ, chẳng hạn như:

- Chúng ta đi giữa các thành phố như thế nào?

- Những nhà hàng tốt nhất ở mỗi thành phố là gì?

- Chúng ta lên lịch các hoạt động khác nhau cùng nhau như thế nào?

Mục tiêu tạo lịch trình sau đó đạt được bằng cách kết hợp giải pháp của từng vấn đề đó.

Utility-Based Agents (Agents dựa trên tiện ích)

Utility-based agents mở rộng goal-based agents bằng cách giới thiệu tối ưu hóa. Thay vì chỉ đạt được mục tiêu, chúng đánh giá các kết quả khác nhau bằng cách sử dụng "hàm tiện ích".

Một hàm tiện ích gán điểm cho các kết quả dựa trên tiêu chí như chi phí, thời gian, rủi ro hoặc sở thích người dùng. Agent sau đó chọn chuỗi hành động tối đa hóa tiện ích tổng thể.

Cách tiếp cận này phổ biến trong các hệ thống đề xuất và bài toán tối ưu hóa. Nó có thể là những thứ như tìm tuyến đường tốt nhất đến một địa điểm, đề xuất sản phẩm phù hợp, hoặc thậm chí đưa ra phân tích tốt nhất để hiển thị cho một người dùng cụ thể.

Learning Agents (Agents học tập)

Learning agents được thiết kế để cải thiện hành vi của chúng theo thời gian mà không cần lập trình lại rõ ràng.

Với mỗi lần lặp, một agent nhận phản hồi và sử dụng thông tin đó để cải thiện hiệu suất của nó. Chúng hoạt động trong các môi trường nơi hành vi tối ưu không được biết trước và không yêu cầu lập trình lại rõ ràng cho từng tình huống mới.

Có hai thành phần chính: một "Critic" (người phê bình) và một "Learning Element" (yếu tố học tập). "Critic" đánh giá kết quả và cung cấp phản hồi. "Learning Element" sử dụng phản hồi này để điều chỉnh các quyết định trong tương lai. Theo thời gian, agent trở nên phù hợp hơn với sở thích người dùng hoặc ràng buộc môi trường.

Ví dụ, hãy tưởng tượng một LLM agent tóm tắt tin tức hàng ngày cho bạn. Nó có thể quan sát hành vi của bạn và thích nghi với sở thích của bạn. Nếu agent nhận thấy bạn hiếm khi mở bản tóm tắt "Thể thao", nhưng quan tâm đến "Ẩm thực", nó có thể ngừng cung cấp bản tóm tắt thể thao và thay vào đó tập trung vào sở thích của bạn về các món ăn hoặc nhà hàng cụ thể.

Tóm tắt các loại LLM agents

Bảng sau tóm tắt sự khác biệt giữa các loại LLM agents.

| Agent | Ý tưởng cốt lõi | Memory | Planning | Learning | Độ phức tạp | Ví dụ |

|---|---|---|---|---|---|---|

| Simple Reflex Agent | Ánh xạ trực tiếp điều kiện đến hành động | Không | Không | Không | Rất thấp | Tự động lưu trữ email có chứa từ "unsubscribe" |

| Model-Based Reflex Agent | Duy trì model nội bộ về môi trường | Có (theo dõi trạng thái) | Tối thiểu | Không | Thấp | Trợ lý IDE nhớ biến hoặc file được định nghĩa trước đó trong phiên |

| Goal-Based Agent | Thực hiện hành động để đạt mục tiêu cụ thể | Có | Có | Không | Trung bình | Đặt vé máy bay, khách sạn và phương tiện cho chuyến công tác |

| Utility-Based Agent | Chọn kết quả tốt nhất dựa trên sở thích | Có | Có | Không | Trung bình đến cao | Đại lý du lịch tối ưu hóa chi phí vs thời gian vs sự thoải mái |

| Learning Agent | Cải thiện hành vi dựa trên phản hồi theo thời gian | Có | Có | Có | Cao | Agent tin tức thích nghi nội dung dựa trên mẫu tương tác người dùng |

Các framework phổ biến để xây dựng LLM agents

Phần này giới thiệu các framework phổ biến được sử dụng để xây dựng các hệ thống LLM agent.

LangChain

LangChain cung cấp một framework modular để xây dựng các hệ thống được hỗ trợ LLM. Ý tưởng cốt lõi của nó là các quy trình làm việc phức tạp có thể được xây dựng bằng cách kết hợp các thành phần đơn giản. Nó giải quyết thách thức giao tiếp với các LLM khác nhau và trừu tượng hóa quy trình đó cho người dùng thông qua các đối tượng Python.

Khái niệm chính trong LangChain là khái niệm "Chains" (chuỗi), liên kết lệnh, model và trình phân tích cú pháp thành các quy trình làm việc có thể lặp lại. Ví dụ, ý tưởng là bạn lấy một PromptTemplate, được đưa vào LLM và được xử lý bởi OutputParser.

LCEL (LangChain Expression Language) cung cấp cú pháp khai báo cho phép người dùng sử dụng pipes (|) để kết hợp các chuỗi một cách trực quan. Vì vậy, thay vì các quy trình làm việc Python cổ điển yêu cầu bạn đưa rõ ràng các lệnh vào model của mình, bạn chỉ cần viết chain = prompt | model và để LangChain xử lý việc tạo template.

Đối với chức năng phức tạp hơn, LangChain cho phép người dùng thêm các công cụ như Wikipedia, Python REPLs và Google Search vào agents của họ.

LangGraph xây dựng dựa trên chức năng của LangChain và kết hợp các khái niệm này với bộ nhớ để hỗ trợ các kiến trúc agent có trạng thái, cấp sản xuất với kiểm soát rõ ràng về luồng thực thi.

Ngoài LangGraph, hệ sinh thái của LangChain đã phát triển hơn nữa để bao gồm các cách quan sát agents dễ dàng hơn (LangSmith) và thậm chí giao diện kéo-thả (LangFlow).

LlamaIndex

LlamaIndex xuất sắc trong các quy trình làm việc tập trung vào tài liệu bằng cách cung cấp OCR và phân tích cú pháp độ chính xác cao cho hơn 90 loại file không có cấu trúc, tùy chọn kết hợp với các quy trình làm việc agentic cho truy xuất và trích xuất thông minh.

Các data connector của nó đơn giản hóa việc nhập từ nhiều nguồn, trong khi các cấu trúc lập chỉ mục của nó tối ưu hóa truy xuất. VectorStoreIndex là lựa chọn phổ biến nhất cho tìm kiếm ngữ nghĩa.

Query engines điều phối truy xuất và tạo nội dung, trong khi routers giới thiệu khả năng ra quyết định giống agent bằng cách chọn nguồn dữ liệu phù hợp nhất cho một truy vấn nhất định.

CrewAI

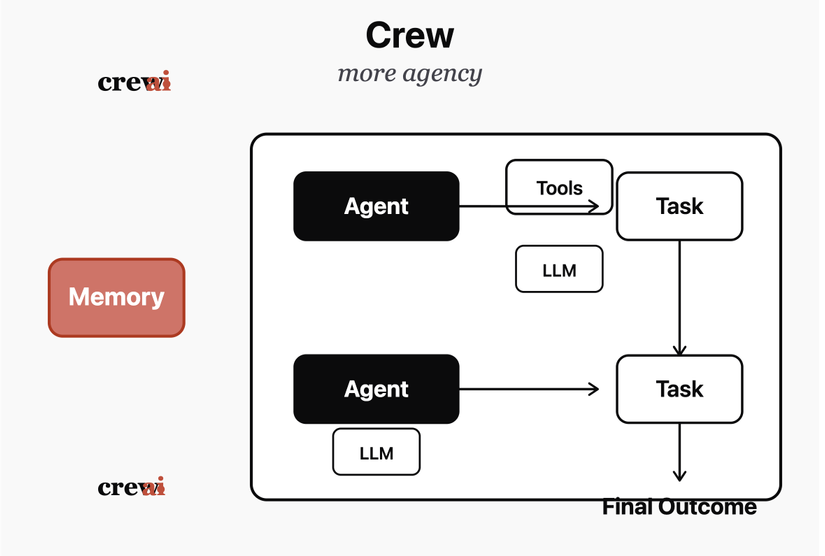

CrewAI được thiết kế xung quanh sự cộng tác. Thay vì một agent duy nhất, nó cho phép nhiều agents với vai trò riêng biệt làm việc cùng nhau.

Nó tập trung vào ý tưởng về "Crews" (đội nhóm), là một tập hợp các agents được định nghĩa. Mỗi agent được gán một persona, mục tiêu và câu chuyện nền tảng, định hình hành vi của nó.

Tasks định nghĩa những gì cần được thực hiện và thành công trông như thế nào. Bạn định nghĩa một công việc cá nhân trông như thế nào, cung cấp một số tham số, đầu ra kỳ vọng và agents nào nên làm việc trên công việc đó.

Processes xác định cách các công việc được thực hiện: tuần tự, theo cấp bậc, hoặc thông qua các mẫu orchestrator-worker nơi một agent chính phân tách động các công việc phức tạp, bắt chước các teams con người.

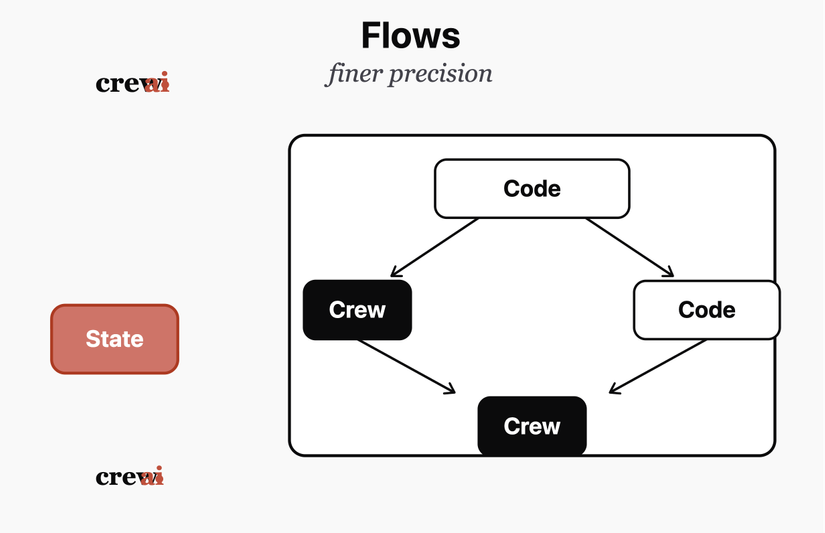

Từ tài liệu CrewAI, chúng ta có thể thấy rằng flows cung cấp cách điều phối và kích hoạt crews. Mỗi crew sử dụng LLM agents với các vai trò và công việc được định nghĩa để thực hiện công việc cụ thể và tạo ra kết quả mong muốn.

Chọn framework phù hợp

Chọn một framework phụ thuộc vào lĩnh vực vấn đề và ràng buộc của bạn. Mỗi framework được trình bày có điểm mạnh riêng:

LangChain: Cung cấp tính linh hoạt và kiểm soát với khả năng hiển thị tốt nhất về cách từng công cụ hoạt động

LlamaIndex: Xuất sắc trong các quy trình làm việc tập trung vào tài liệu nơi phân tích cú pháp thông tin là quan trọng

CrewAI: Nổi bật khi sự cộng tác và phân vai quan trọng, và bạn ít tập trung vào chính xác cách agents hoàn thành công việc

Hãy xem xét độ phức tạp dữ liệu, mức độ tự chủ cần thiết và ràng buộc hoạt động của bạn. Không có lựa chọn đúng đắn phổ quát.

Các trường hợp sử dụng LLM agent

Các trường hợp sử dụng cho LLM agents về cơ bản là vô tận và chỉ bị giới hạn bởi trí tưởng tượng của bạn.

Trợ lý lập trình

Các trợ lý lập trình hiện đại sử dụng các quy trình làm việc agentic để lập kế hoạch, thực thi và xác minh thay đổi. Chúng có thể khám phá codebase, tạo giải pháp, chạy kiểm tra và sửa lỗi lặp đi lặp lại.

Ví dụ, Cursor tích hợp vào IDE của bạn một cách tự nhiên và giúp bạn hoàn thành các dòng hoặc sửa thay đổi cho pipelines với các hệ quả downstream. Claude Code có thể giúp bạn viết kiểm tra, tạo toàn bộ script hoặc đánh giá sự không nhất quán trong code của bạn qua một repo. Chúng ta có thể sử dụng GitHub Copilot để giúp viết pull requests và kiểm tra code như một phần của quy trình yêu cầu.

Điều này chuyển vai trò nhà phát triển từ viết từng dòng sang giám sát và hướng dẫn các hệ thống thông minh. Đối với người làm việc với dữ liệu, điều này có thể tăng tốc đáng kể thử nghiệm và nguyên mẫu.

Phân tích kinh doanh

Các hệ thống BI agentic cho phép người dùng đặt câu hỏi bằng ngôn ngữ tự nhiên và nhận thông tin chi tiết có thể hành động. Agent có thể dịch câu hỏi thành SQL, thực thi truy vấn và giải thích kết quả.

Bạn có thể nói chuyện với dữ liệu của mình như bạn nói chuyện với một thành viên cấp cao trong team và nhận thông tin chi tiết và trực quan hóa mới trong thời gian thực. Điều này làm giảm sự phụ thuộc vào bảng điều khiển và cho phép phân tích khám phá cho các thành viên trong team không chuyên về kỹ thuật.

Tổng hợp tài liệu và thông tin

Research agents tự động hóa việc thu thập và tổng hợp thông tin. Chúng tìm kiếm web, truy xuất nguồn và tóm tắt phát hiện; một số hệ thống bao gồm các bộ lọc chất lượng nguồn cơ bản. Chúng thậm chí có thể xem tài liệu nội bộ được lưu trữ trên các trang web như Notion hoặc tin nhắn trong Slack.

Với quyền truy cập vào tất cả các nguồn thông tin này, LLM agents không chỉ có thể nhanh chóng tổng hợp thông tin mà còn tạo ra toàn bộ tài liệu và tài liệu tóm tắt cho teams để nhanh chóng chia sẻ thông tin.

Điều này đặc biệt có giá trị trong các lĩnh vực di chuyển nhanh nơi các bộ dữ liệu tĩnh nhanh chóng trở nên lỗi thời. Agents cung cấp thông tin chi tiết được làm mới liên tục.

Những thách thức chính trong quy trình làm việc agentic

Mặc dù các quy trình làm việc agentic tuyệt vời và cực kỳ mạnh mẽ, chúng đi kèm với những thách thức riêng. Agents có thể hallucinate các bước, hiểu sai đầu ra công cụ hoặc nhập vào các vòng lặp dài hoặc ngoài ý muốn. Guardrails, xác thực và khả năng quan sát là quan trọng cho các hệ thống sản xuất.

Mỗi hành động agent thường yêu cầu một lần gọi LLM. Các công việc phức tạp có thể liên quan đến hàng chục lần gọi, tăng độ trễ và chi phí API. Ngoài ra, bạn có thể phải trả cho cơ sở hạ tầng bổ sung như lưu trữ đám mây, tính toán đám mây và các chi phí khác để hỗ trợ LLM agent.

Các hệ thống tự chủ khó debug hơn code xác định. Hiểu tại sao một agent đưa ra quyết định yêu cầu theo dõi trạng thái, bộ nhớ và các bước suy luận.

Tùy thuộc vào framework agent nào bạn sử dụng, điều này có thể cực kỳ thách thức. Một số framework, như CrewAI, trừu tượng hóa sâu hơn nhiều do độ phức tạp bổ sung của chúng so với framework đơn giản hơn như LangChain, có trọng tâm là đơn giản hóa việc truy cập LLM của bạn.

Kết luận

Chúng ta đang chuyển đổi từ các chatbot độc lập sang các quy trình làm việc agentic đầy đủ có thể suy luận, lập kế hoạch và hành động. Mặc dù vẫn còn sớm, mô hình này đã định hình lại cách các hệ thống dữ liệu được xây dựng và sử dụng.

Đối với những người mong muốn làm việc với dữ liệu, học về LLM agents ngày hôm nay cung cấp lợi thế mạnh mẽ cho các vai trò của ngày mai. Các hệ thống này đại diện cho tương lai của tự động hóa thông minh.

Câu hỏi thường gặp về LLM agents

LLM agents có tự viết và thực thi code không?

LLM agents không tự thực thi code. Chúng quyết định khi nào gọi các công cụ, chẳng hạn như trình thông dịch Python, công cụ SQL hoặc môi trường thực thi sandbox, sau đó chạy code và trả kết quả cho agent.

Các thành phần cốt lõi của LLM agent là gì?

Các thành phần cốt lõi là LLM brain, planning logic, memory và tools. Các thành phần này làm việc cùng nhau trong một vòng lặp phản hồi để cho phép hành vi tự chủ.

Các loại LLM agents nào được sử dụng phổ biến nhất hiện nay?

Hầu hết các hệ thống sản xuất sử dụng goal-based hoặc utility-based agents vì chúng cân bằng tính tự chủ với kiểm soát. Learning agents đang nổi lên, nhưng khó triển khai an toàn ở quy mô.

Những thách thức lớn nhất với LLM agents là gì?

Các thách thức chính bao gồm các vấn đề độ tin cậy như hallucinations, độ trễ cao hơn, chi phí tăng do nhiều lần gọi model, cũng như độ phức tạp debugging tăng so với phần mềm truyền thống.

LLM agent khác chatbot như thế nào?

Một chatbot trả lời một câu hỏi duy nhất và tập trung vào một mục tiêu đơn lẻ. Một LLM agent có thể chia nhỏ mục tiêu thành các bước, thực hiện hành động sử dụng công cụ, quan sát kết quả và thích nghi hành vi của nó cho đến khi công việc hoàn thành.

All Rights Reserved