9 API Dữ liệu Web Thiết yếu cho AI Agent & Nhà phát triển năm 2026

Ở giai đoạn phát triển này của AI, hiệu suất của các Mô hình Ngôn ngữ Lớn (LLMs) phụ thuộc rất nhiều vào chất lượng dữ liệu đầu vào từ bên ngoài. Một thực tế ai cũng biết là AI hiện tại vẫn có thể tạo ra thông tin sai lệch hoặc gặp phải hiện tượng ảo giác LLM (LLM hallucinations) chỉ để tỏ ra hiểu biết. Nhưng đừng lo—bằng cách tận dụng các API Dữ liệu Web và công nghệ RAG (Retrieval-Augmented Generation), các nhà phát triển có thể trang bị cho AI khả năng tìm kiếm trên web, trích xuất nội dung chuyên sâu và tạo ra các câu trả lời có căn cứ rõ ràng.

Spider: API Cào dữ liệu Web Đồng thời cao dựa trên Rust

Spider là một API cào dữ liệu web (web scraping) được xây dựng để đạt hiệu suất tối đa. Được viết bằng ngôn ngữ Rust, nó được tối ưu hóa sâu sắc dành riêng cho các ứng dụng AI. Công cụ này hỗ trợ cào hàng ngàn trang web cùng lúc với độ đồng thời cao và có thể trả về trực tiếp dữ liệu Markdown đã được làm sạch hoặc dữ liệu JSON có cấu trúc.

Quy trình hoạt động của Spider được chia thành ba giai đoạn: thu thập, xử lý và phân phối. Nó sở hữu chế độ thông minh tự động chuyển đổi giữa các yêu cầu HTTP truyền thống và kết xuất trình duyệt headless để cân bằng giữa tốc độ và tỷ lệ cào thành công. Đối với các trang web được bảo vệ bởi cơ chế chống bot (anti-bot), Spider tích hợp sẵn công nghệ làm giả dấu vân tay và engine tự động thử lại.

Ví dụ Tích hợp Python:

import requests, json

headers = {

'Authorization': 'Bearer $SPIDER_API_KEY',

'Content-Type': 'application/json',

}

json_data = {"limit": 5, "url": "https://example.com"}

response = requests.post('https://api.spider.cloud/crawl',

headers=headers, stream=True)

with response as r:

r.raise_for_status()

for chunk in response.iter_content(chunk_size=8192):

if chunk:

print(json.loads(chunk.decode('utf-8')))

Firecrawl: Chuyển đổi Trang web Phức tạp sang Markdown cho LLMs

Firecrawl tập trung vào việc chuyển đổi nội dung web sang các định dạng phù hợp để xử lý bằng mô hình lớn. Nó không chỉ cào các trang; nó còn hỗ trợ ánh xạ sơ đồ trang web (sitemap) để tự động khám phá các trang quan trọng trong một website. Công cụ này cung cấp môi trường sandbox trình duyệt để xử lý các tác vụ web tương tác và hỗ trợ giao thức MCP (Model Context Protocol), giúp dễ dàng tích hợp vào các trợ lý lập trình khác nhau.

Lệnh Khởi động Nhanh:

npx -y firecrawl-cli@latest init --all --browser

Tavily: Lớp Tìm kiếm AI Theo thời gian thực cho Agents

API Tavily được định vị là một lớp tìm kiếm nhanh dành cho các mô hình AI. Khác với các công cụ tìm kiếm truyền thống, kết quả tìm kiếm của nó đã được lọc và khử nhiễu, sẵn sàng để một AI Agent sử dụng trực tiếp cho các tác vụ nghiên cứu nhiều bước. Nó cung cấp một API nghiên cứu hỗ trợ các cuộc điều tra tự động sâu hơn, và máy chủ MCP được lưu trữ của nó giúp giảm đáng kể chi phí cấu hình.

Lệnh Tích hợp:

npx skills add https://github.com/tavily-ai/skills

Apify: Nền tảng Tự động hóa Web Mô-đun

Apify cung cấp một thư viện công cụ tự động hóa khổng lồ thông qua cơ chế Actor. Client API chính thức của nó hỗ trợ JavaScript và TypeScript, với cơ chế tự động thử lại (automatic retries) và lùi bước theo cấp số nhân để xử lý các yêu cầu mạng không ổn định. Nó không chỉ là một công cụ cào web; nó còn quản lý các kho lưu trữ khóa-giá trị (key-value stores) và tập dữ liệu, khiến nó trở nên hoàn hảo để xây dựng các tác vụ tự động hóa dài hạn, phức tạp.

Triển khai Node.js:

import { ApifyClient } from 'apify-client';

const client = new ApifyClient({ token: 'MY-APIFY-TOKEN' });

const run = await client.actor('apify/web-scraper').call({

startUrls: [{ url: 'https://example.com' }],

maxCrawlPages: 10,

});

const { items } = await client.dataset(run.defaultDatasetId).listItems();

console.log(items);

Exa: Tìm kiếm Ngữ nghĩa Dựa trên Mạng Nơ-ron

Tìm kiếm ngữ nghĩa Exa sử dụng mạng nơ-ron để hiểu ngữ cảnh của nội dung web, thay vì dựa vào việc khớp từ khóa đơn giản. Điều này làm cho nó có độ chính xác cao khi tìm kiếm tài liệu mã nguồn, báo cáo nghiên cứu hoặc tin tức chuyên ngành. Các kỹ năng nghiên cứu công ty do Exa cung cấp có thể tích hợp liền mạch vào các trợ lý mã hóa, giúp nhà phát triển nhanh chóng thu thập tài liệu nền tảng mục tiêu.

Ví dụ Gọi bằng Python:

from exa_py import Exa

exa = Exa(api_key="your-api-key")

result = exa.search(

"Các bài blog chuyên sâu về trí tuệ nhân tạo",

type="auto",

contents={"highlights": {"max_characters": 4000}}

)

ScrapingBee: API Trình duyệt Headless Đơn giản hóa

ScrapingBee đóng gói việc quản lý trình duyệt headless phức tạp vào một API đơn giản. Các nhà phát triển không cần tự bảo trì các phiên bản Chrome để xử lý kết xuất JavaScript và nội dung tải động. Công cụ này tự động quản lý việc luân phiên proxy và vượt qua CAPTCHA.

Ví dụ Tích hợp Python:

from scrapingbee import ScrapingBeeClient

client = ScrapingBeeClient(api_key='YOUR-API-KEY')

response = client.get("https://example.com")

print('Mã trạng thái: ', response.status_code)

print('Nội dung: ', response.content)

Bright Data: Công cụ Vượt rào cản Web Cấp Doanh nghiệp

Bright Data có lợi thế rõ rệt khi xử lý các trang web mục tiêu có độ khó cao. Nó cung cấp một ngăn xếp dữ liệu web hoàn chỉnh, bao gồm API Unblocker, mạng proxy dân cư và các công cụ tự động hóa trình duyệt. Khi các công cụ cào dữ liệu cơ bản bị tường lửa chặn, Web MCP của nó có thể duy trì đường dẫn truy cập ổn định để vượt qua các hệ thống chống bot nâng cao.

Lệnh Tích hợp MCP:

npx @brightdata/mcp

You.com: API Nghiên cứu Kiểm chứng Thực tế có Trích dẫn

API You.com cung cấp kết quả tìm kiếm với các trích dẫn và bằng chứng nguồn chính xác, mang lại hiệu quả cao trong việc giảm thiểu ảo giác AI. Nền tảng này hỗ trợ tìm kiếm tin tức được lọc nâng cao và trích xuất nội dung dài. Nhà phát triển có thể sử dụng Agent Skills của nó để tích hợp vào các luồng công việc phát triển hiện có.

Lệnh Thêm Kỹ năng:

npx skills add youdotcom-oss/agent-skills

Brave Search API: Chỉ mục Internet Độc lập

Brave Search sở hữu một chỉ mục web hoàn toàn độc lập. Nó cung cấp API AI Answers, có thể trả về trực tiếp thông tin tóm tắt được tạo dựa trên các nguồn. Sự độc lập này làm cho kết quả tìm kiếm của nó có tính cạnh tranh cao về độ mới mẻ và khách quan, cung cấp một góc nhìn dữ liệu khác biệt cho các AI Agent.

Lệnh Cài đặt Kỹ năng:

npx openskills install brave/brave-search-skills

Nền tảng: Thiết lập Môi trường Phát triển Cục bộ 1-Click với ServBay

Khi thực sự gọi các API được đề cập ở trên, việc cấu hình môi trường phát triển cục bộ thường là rào cản lớn đầu tiên. Cho dù bạn đang chạy một tập lệnh cào dữ liệu web bằng Python hay một luồng tự động hóa Node.js, bạn đều cần một môi trường ổn định hỗ trợ đa phiên bản.

ServBay cung cấp sự hỗ trợ nền tảng hiệu quả cao cho các nhà phát triển. Sức mạnh cốt lõi của nó nằm ở việc triển khai môi trường phát triển chỉ với một cú nhấp chuột. Với công cụ này, nhà phát triển có thể nhanh chóng thiết lập một môi trường cục bộ hỗ trợ sự tồn tại song song của nhiều phiên bản, dọn đường cho việc tích hợp API liền mạch.

Cấu hình 1-Click cho Môi trường Đa ngôn ngữ

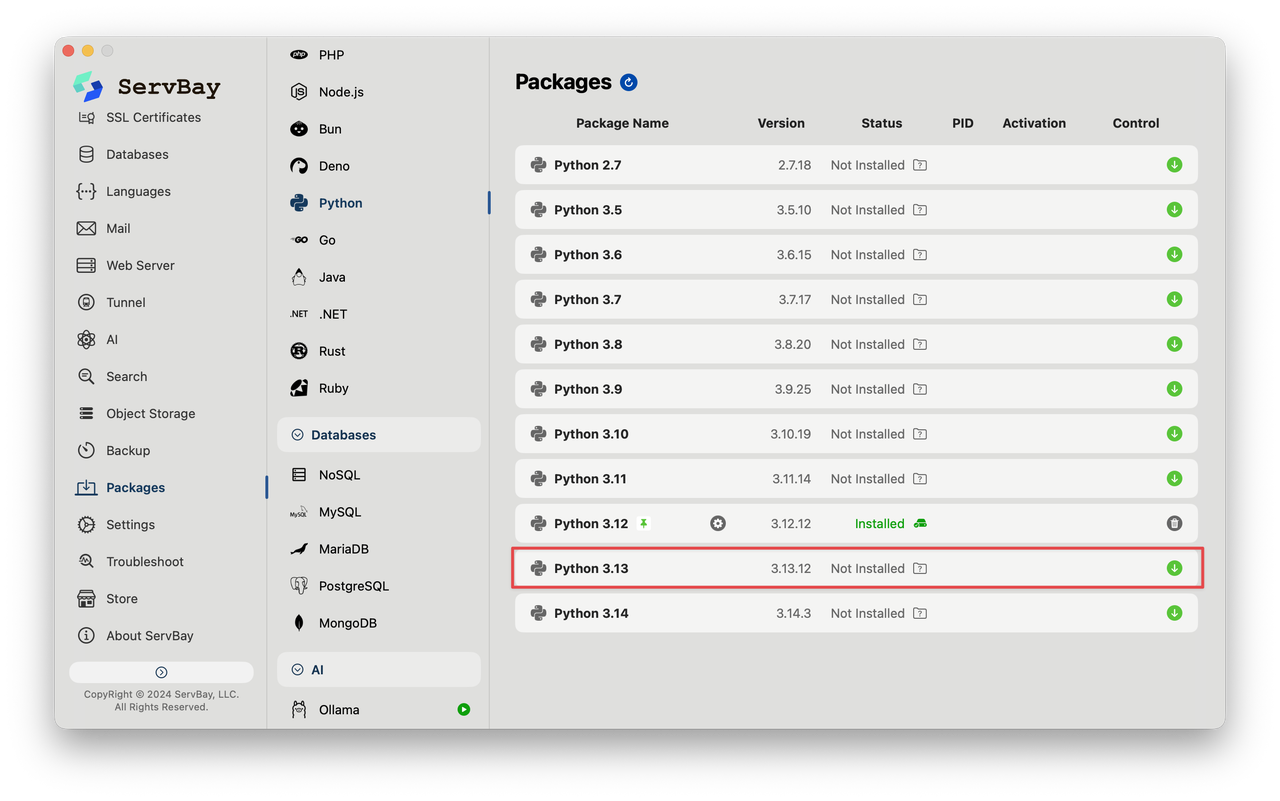

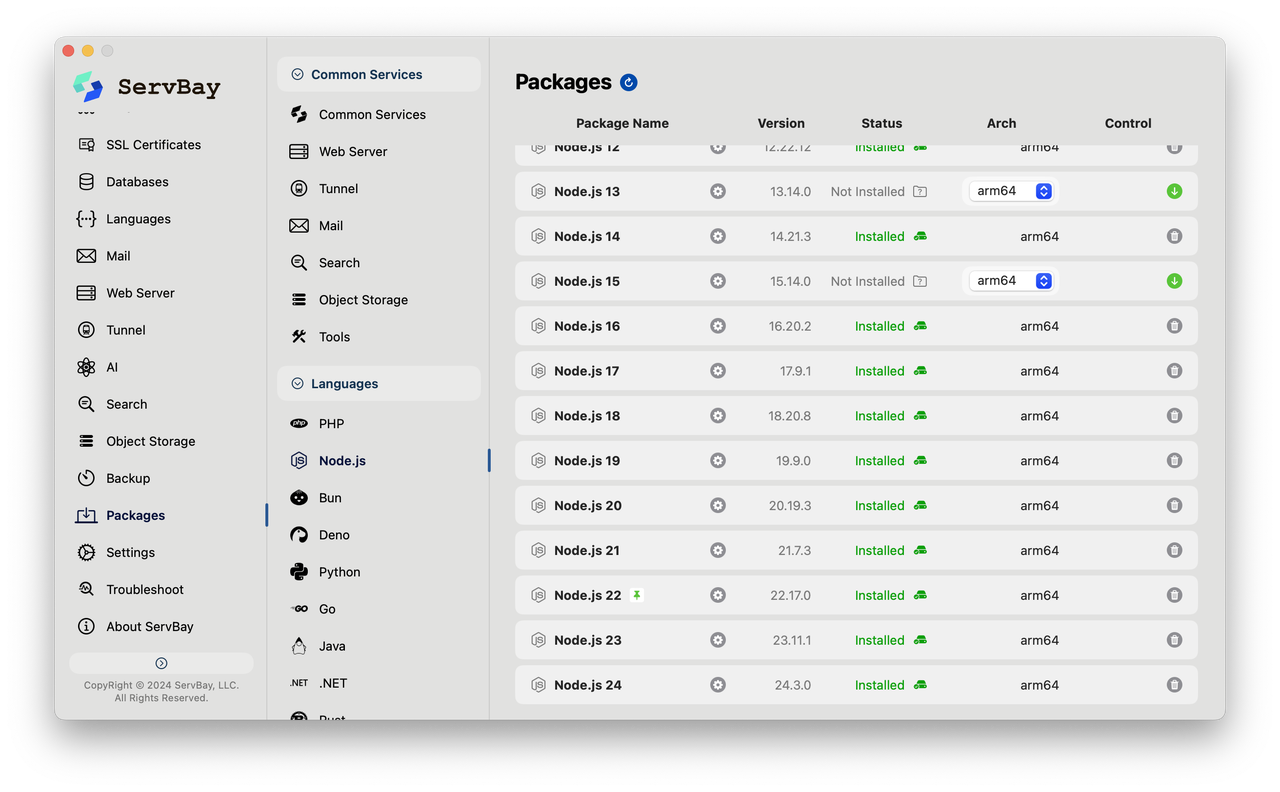

Đối với các nhà phát triển cần sử dụng SDK Python (như Exa, ScrapingBee) hoặc SDK Node.js (như Apify, Firecrawl), ServBay hỗ trợ triển khai môi trường Python và môi trường Node.js chỉ với một cú nhấp chuột.

Lợi thế lớn nhất của nó là khả năng chạy đồng thời nhiều phiên bản. Điều này có nghĩa là bạn có thể gỡ lỗi một dự án Node.js cũ và chạy tập lệnh cào dữ liệu Spider dựa trên Python mới nhất trên cùng một hệ thống mà không cần lo lắng về việc ô nhiễm môi trường hay xung đột phiên bản. Phương pháp quản lý môi trường cục bộ này giúp tăng đáng kể hiệu suất, từ khâu nghiên cứu API cho đến xây dựng nguyên mẫu sản phẩm.

Lựa chọn Công nghệ & Khuyến nghị Triển khai

Bảng dưới đây nêu bật sự khác biệt về khả năng cốt lõi, yêu cầu môi trường và các trường hợp sử dụng tốt nhất cho từng công cụ.

| Tên Công cụ | Trọng tâm Kỹ thuật | Môi trường Khuyên dùng | Trường hợp Sử dụng Tốt nhất |

|---|---|---|---|

| Spider | Đồng thời cao, Engine Rust | Python/Rust | Cào dữ liệu song song quy mô lớn, Backend RAG |

| Firecrawl | Chuyển đổi Markdown | Node.js | Trích xuất nội dung web cho AI Agents |

| Tavily | Tìm kiếm chuyên dụng cho Agent | Python/JS | Truy xuất thông tin thời gian thực, nghiên cứu tự động |

| Apify | Luồng tự động hóa mô-đun | Node.js | Giám sát MXH, cào dữ liệu tương tác phức tạp |

| Exa | Tìm kiếm ngữ nghĩa mạng nơ-ron | Python | Nghiên cứu sâu, định vị tài liệu chuyên ngành |

| ScrapingBee | Kết xuất trình duyệt Headless | Python | Cào trang web động tải nhiều JS |

| Bright Data | Vượt qua anti-bot nâng cao | Node.js/Python | Thu thập dữ liệu từ các trang web thương mại bảo mật cao |

| You.com | Kiểm chứng thực tế & trích dẫn | REST API | Tạo báo cáo nghiên cứu chính xác |

| Brave Search | Chỉ mục dữ liệu độc lập | REST API | Tránh kết quả tìm kiếm đồng nhất |

| ServBay | Triển khai môi trường | macOS | Cùng tồn tại đa phiên bản Python/Node.js cục bộ |

Kết luận

Đối với các nhà phát triển, API Dữ liệu Web cung cấp một cửa sổ để kết nối với internet theo thời gian thực, trong khi ServBay cung cấp nền tảng cục bộ để giữ cho các công cụ này hoạt động trơn tru. Trong giai đoạn khởi động dự án, chúng tôi đặc biệt khuyên bạn nên sử dụng ServBay để triển khai Python và Node.js chỉ với một cú nhấp chuột, đảm bảo tính ổn định của môi trường cục bộ.

Sau đó, dựa trên độ khó của việc cào dữ liệu, yêu cầu về độ đồng thời và nhu cầu hiểu ngữ nghĩa, hãy chọn API phù hợp nhất từ danh sách trên để tích hợp. Mô hình phát triển này—kết hợp một môi trường nền tảng vững chắc với các giao diện cấp cao mạnh mẽ—là con đường hiệu quả nhất để xây dựng các ứng dụng AI hiệu suất cao.

All Rights Reserved